Des artistes créent un outil spécial pour empoisonner l'IA

La capacité de l’intelligence artificielle à produire des peintures, à créer des images représentant n’importe quel objet ou à imiter divers styles artistiques est étonnante. Un tel processus de génération implique de former l’IA à l’aide d’œuvres d’art réelles, dont beaucoup sont créées par des artistes sans recevoir de rémunération.

Face à cette situation, les artistes font preuve de résistance face à l’IA et s’apprêtent à avoir accès à un outil pour la contrer : Nightshade.

Que signifie empoisonner les œuvres

Ben Zhao , professeur à l' Université de Chicago , qui a dirigé l'équipe qui a créé Nightshade , a déclaré au portail d'évaluation du MIT que l'objectif du programme est de « contribuer à faire pencher la balance des pouvoirs des sociétés d'IA vers les artistes ». fonction dissuasive contre les atteintes aux droits d’auteur et aux droits intellectuels des créateurs.

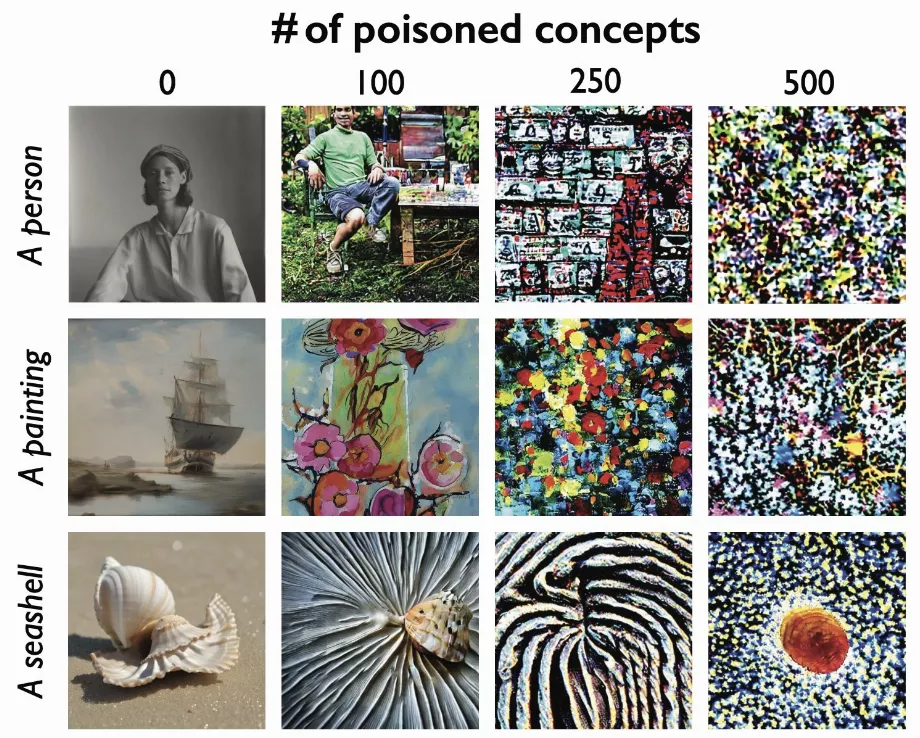

L'empoisonnement de Nightshade implique l'ajout de modifications invisibles aux pixels de l'art avant de le télécharger en ligne, donc s'il est inclus dans un ensemble de formation d'IA, le modèle de langage peut générer une réponse incongrue.

Cela se produit car lors du processus de préparation des données à partir des modèles de langage, des erreurs peuvent être commises lors de la suppression du contenu problématique. Si le contenu biaisé n’est pas correctement filtré, l’IA pourrait tirer des leçons de ces erreurs, entraînant un empoisonnement.

Nightshade profite du fait que les modèles de langage sont formés avec de grandes quantités de données (dans ce cas, des images extraites d'Internet).

Utilisation par les artistes

L'équipe de Zhao a développé un outil appelé Glaze , qui permet aux artistes de « masquer » leur style personnel pour empêcher les sociétés d'IA de le supprimer.

Cet outil fonctionne de manière similaire à Nightshade , apportant des modifications subtiles aux pixels de l'image qui sont imperceptibles à l'œil humain, mais incitent les modèles d'apprentissage automatique à interpréter l'image différemment de ce qu'elle montre réellement.

L'équipe prévoit d'incorporer Nightshade dans Glaze, donnant aux artistes la possibilité d'utiliser l'outil d'empoisonnement des données selon leurs préférences. De plus, ils travaillent à rendre Nightshade open source, ce qui permettra à d'autres utilisateurs de l'expérimenter et de développer leurs propres variantes.

Zhao souligne que plus l'adoption de l'outil et la création de versions personnalisées par la communauté seront répandues, plus l'outil deviendra puissant dans sa capacité à protéger l'expression artistique et à préserver le style personnel des créateurs, en les aidant à éviter la suppression ou la suppression indésirable. manipulation de vos œuvres par des algorithmes d’intelligence artificielle .

Les artistes qui souhaitent partager leur travail en ligne sans que leurs images soient censurées par des sociétés d'IA peuvent utiliser Glaze pour masquer leurs œuvres dans un style artistique différent du leur. De plus, ils ont la possibilité d’utiliser Nightshade.

Essentiellement, ces outils permettent aux artistes de protéger leur expression artistique et de maintenir leur style, tout en introduisant un élément de confusion dans les données utilisées par les modèles d'intelligence artificielle, empêchant les œuvres d'être supprimées ou mal interprétées par lesdits modèles.

Essais d'empoisonnement

Les chercheurs ont testé cette attaque sur les derniers modèles de diffusion stable et sur un modèle d’IA qu’ils ont construit à partir de zéro.

Lorsqu’ils ont fourni à Stable Diffusion seulement 50 images de chiens empoisonnés et lui ont ensuite demandé de générer des images de ce même animal, les résultats ont commencé à montrer des anomalies notables, telles que des créatures à plusieurs membres et des traits du visage caricaturaux.

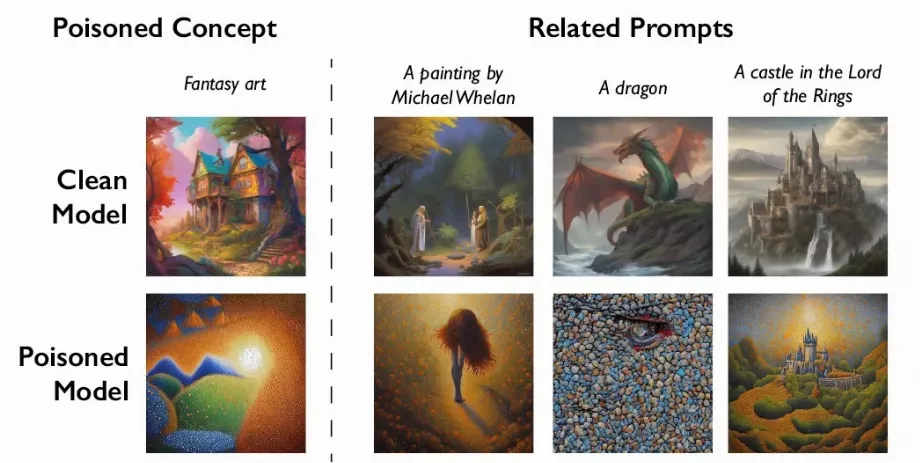

L’attaque empoisonnée fonctionne également avec des images tangentiellement liées. Par exemple, si le modèle extrayait une image empoisonnée pour l'invite « art fantastique », les invites « dragon » et « un château dans Le Seigneur des Anneaux » seraient de la même manière manipulées pour obtenir autre chose.

Zhao admet qu'il existe un risque que des personnes abusent de la technique d'empoisonnement des données à des fins malveillantes . Cependant, il affirme que les attaquants auraient besoin de milliers d’échantillons empoisonnés pour infliger de réels dégâts à des modèles plus grands et plus puissants, puisqu’ils sont formés sur des milliards d’échantillons de données.

Comment activer le mode football sur une Smart TV pour regarder la Copa América

Avec l'effervescence de la Copa América, plusieurs fans recherchent la meilleure façon de regarder les matchs sur leur Smart TV. L’une des meilleures alternatives est le mode football ou le mode sport.

Modern Family est la vedette d'une publicité WhatsApp destinée aux familles équipées d'iPhone et d'Android

WhatsApp a réuni une partie du casting de Modern Family pour jouer dans une nouvelle publicité axée sur la promotion de groupes entre familles utilisant à la fois des appareils iPhone et Android.

Glossaire technologique : quels types d'innovation existe-t-il

Au cours des dernières décennies, la technologie est non seulement devenue un outil de base, mais elle fait également partie de notre vie quotidienne, au point qu’il est presque impossible d’imaginer ce que serait d’accomplir des tâches sans elle.

Tether : quel est le prix de cette cryptomonnaie ce 19 juin

Tether, la cryptomonnaie de type stablecoin qui prétend que chacun de ses tokens est adossé à un dollar américain, est émise par la société Tether Limited et depuis ses origines a été impliquée dans diverses controverses.

Comment personnaliser WhatsApp avec le mode cœur noir

Pour les utilisateurs de WhatsApp souhaitant personnaliser leur expérience, l’activation du « mode cœur noir » est une excellente option. Ce mode remplace l’icône d’appel téléphonique standard (qui est généralement blanche) par l’emoji cœur noir.